Amazon S3 Storage: Ein Guide für Unternehmen

Diese Seite teilen

Yifat Perry

Was ist Amazon S3 Storage?

Ein ausführlicher Guide für Unternehmen

Amazon Simple Storage Service (Amazon S3) ist ein skalierbarer, hochverfügbarer Objektspeicherdienst, der sich insbesondere für Unternehmen eignet, die große Mengen unstrukturierter Daten verwalten müssen. S3 wird typischerweise in Szenarien wie Data Lakes, Backup und Recovery, Analyseworkloads, mobiler App-Entwicklung oder Archivierung eingesetzt und lässt sich nahtlos in Lösungen wie NetApp Cloud Volumes ONTAP integrieren.

S3 ermöglicht die gezielte Verwaltung, Strukturierung und Zugriffskontrolle auf Daten gemäß unternehmensspezifischen und regulatorischen Anforderungen, ein entscheidender Faktor für moderne Cloud-Architekturen.

Anwendungsfälle von Amazon S3

Backup und Disaster Recovery

Amazon S3 kann Daten automatisch über mehrere AWS-Regionen hinweg replizieren. Dies erhöht die Ausfallsicherheit und bietet eine stabile Grundlage für unternehmenskritische Backups. Die Versionierung unterstützt die Wiederherstellung früherer Dateistände und bietet Schutz vor versehentlichem Datenverlust.

Datenanalyse

Mit Amazon S3 können Analysen direkt auf gespeicherten Daten durchgeführt werden, ohne dass diese verschoben werden müssen. Die native Integration mit Drittsystemen ermöglicht es Unternehmen, S3 nahtlos in bestehende Analyse-Stacks zu integrieren, z. B. zur Auswertung von IoT-Datenströmen oder im Big-Data-Umfeld.

Datenarchivierung

Für langfristige und kostengünstige Aufbewahrung sensibler oder revisionspflichtiger Daten stellt Amazon S3 mit Glacier und Glacier Deep Archive ideale Speicherklassen zur Verfügung. Lifecycle-Policies ermöglichen die automatische Archivierung zu vordefinierten Zeitpunkten, ein Pluspunkt für Compliance und Effizienz.

Sicherheit und Compliance

Amazon S3 erfüllt zahlreiche internationale Sicherheits- und Datenschutzstandards, darunter PCI-DSS, HIPAA, FedRAMP oder DSGVO. Funktionen wie Server- und Client-seitige Verschlüsselung, Bucket-Richtlinien und rollenbasierter Zugriffsschutz (IAM) gewährleisten die Einhaltung regulatorischer Anforderungen, ein wichtiger Aspekt auch für NetApp-Kunden mit sensiblen Daten-Workloads.

Wie funktioniert Amazon S3?

Amazon S3 speichert Daten als Objekte in sogenannten Buckets. Jedes Objekt enthält die eigentliche Datei sowie zugehörige Metadaten. Die Verwaltung erfolgt über eine benutzerfreundliche Webkonsole oder via API.

Objekte und Buckets im Amazon S3

- Objekte: Einzelne Datenentitäten (Dateien) mit eindeutiger ID (Key)

- Buckets: Container für die Organisation und Verwaltung von Objekten

- Jeder Bucket ist global eindeutig benannt und einer AWS-Region zugeordnet

Verwaltung über die S3-Konsole

Die AWS Management Console bietet eine browserbasierte Oberfläche für das Erstellen und Verwalten von Buckets, das Hochladen von Dateien sowie für die Konfiguration von Zugriffsrechten und Speicherklassen. Durch logische Hierarchien (Präfixe, Trennzeichen) lässt sich die Struktur flexibel an die verschiedenen Bedarfe von Unternehmen anpassen.

Speicherklassen in Amazon S3

Amazon S3 bietet sieben verschiedene Speicherklassen, die sich hinsichtlich Kosten, Zugriffsfrequenz und Redundanz unterscheiden. Unternehmen können so ihre Daten effizient nach Nutzungshäufigkeit und Verfügbarkeit kategorisieren:

- S3 Standard: Für häufig genutzte Daten mit geringer Latenz

- S3 Intelligent-Tiering: Automatischer Wechsel der Speicherklasse je nach Zugriffsmuster

- S3 Standard-IA: Für selten genutzte, aber schnell verfügbare Daten

- S3 One Zone-IA: Günstige Variante mit Speicherung in nur einer Verfügbarkeitszone

- S3 Glacier: Für Archivdaten mit Abrufzeiten von Minuten bis Stunden

- S3 Glacier Deep Archive: Für Daten, die sehr selten benötigt werden

- S3 Outposts: Lokale Speicherlösung für regulierte Umgebungen

Mit Lifecycle-Management-Richtlinien können Daten automatisch zwischen den Klassen verschoben werden, ein wichtiger Hebel zur Kostenoptimierung.

Amazon S3-Tutorial: Erste Schritte mit Amazon S3

S3-Bucket erstellen

Voraussetzung: Ein aktives AWS-Konto.

Schritte zur Erstellung eines Buckets:

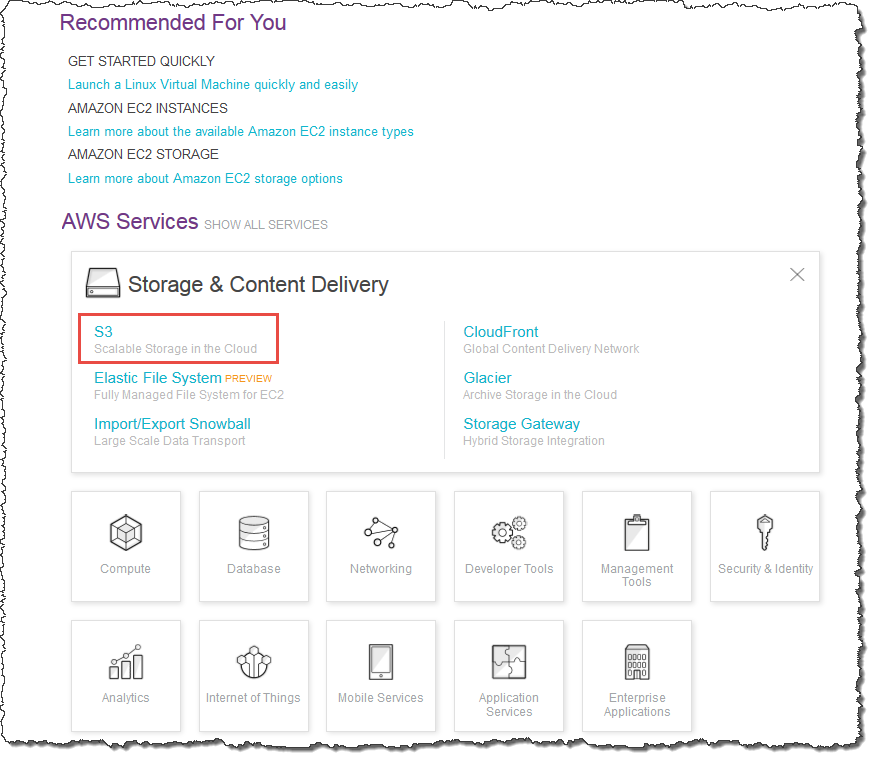

- Anmeldung in der AWS Management Console

Bildquelle: Bildquelle: AWS

- Navigation zur S3-Konsole:

https://console.aws.amazon.com/s3/ - Auswahl von „Bucket erstellen"

Bildquelle: AWS

Bildquelle: AWS - Eingabe eines eindeutigen, DNS-konformen Bucket-Namens

- Auswahl einer passenden Region, möglichst nah an der Nutzlast zur Minimierung von Latenz und Kosten

- Abschluss mit „Bucket erstellen"

Ein Objekt in den Bucket hochladen bei Amazon S3

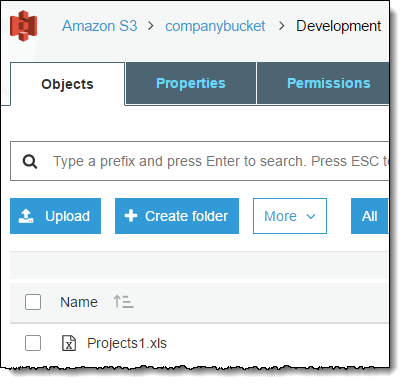

- Öffnen Sie die S3-Konsole und wählen Sie den erstellten Bucket aus.

- Navigieren Sie zum Tab „Objekte" und klicken Sie auf „Hochladen".

- Wählen Sie über „Dateien hinzufügen" das gewünschte File.

Bildquelle: AWS

Bildquelle: AWS - Bestätigen Sie mit „Hochladen".

AWS S3 Sicherheit und Datenschutz

Amazon S3 bietet eine äußerst belastbare Speicherinfrastruktur, die speziell für geschäftskritische und primäre Datenspeicherung entwickelt wurde. Datenobjekte werden redundant über mehrere Geräte und Rechenzentren innerhalb einer AWS-Region verteilt gespeichert, mit dem Ziel, maximale Verfügbarkeit und Datenhaltbarkeit sicherzustellen.

Hohe Datenverfügbarkeit und -haltbarkeit

Amazon S3 schützt Ihre Daten mit einem umfassenden Ansatz zur Redundanz und automatisierten Wiederherstellung:

- 99,99 % Verfügbarkeit und 99,999999999 % (elf Neunen) Haltbarkeit der gespeicherten Objekte pro Jahr

- Ausgelegt auf gleichzeitige Ausfälle in zwei Verfügbarkeitszonen

- Unterstützt durch das offizielle Service Level Agreement (SLA) von Amazon S3

Wenn Sie ein Objekt hochladen oder per PUT bzw. PUT Object – Copy speichern, repliziert Amazon S3 die Daten synchron über mehrere Availability Zones hinweg. Nach der Speicherung überwacht S3 kontinuierlich die Datenintegrität und repariert automatisch etwaige Redundanzverluste.

Versionierung: Schutz vor versehentlichen Änderungen

Zusätzlich unterstützt Amazon S3 die Versionierung von Objekten. Damit lassen sich alle Versionen eines Objekts verwalten, wiederherstellen und sichern. Die Versionierung ermöglicht:

- Wiederherstellung früherer Versionen bei Anwendungsfehlern oder Benutzerfehlern

- Standardmäßig wird stets die aktuellste Version eines Objekts ausgeliefert

- Durch gezielte Anfrage kann auch eine ältere Version abgerufen werden

Dieses Feature ist besonders wertvoll für Unternehmen, die Anforderungen an Revisionssicherheit, Backup-Richtlinien oder Disaster-Recovery erfüllen müssen.

Datenverschlüsselung

Datenverschlüsselung im Ruhezustand (at rest) und während der Übertragung (in transit):

- Server-seitige Verschlüsselung (SSE): Amazon S3 übernimmt die Verschlüsselung beim Speichern und die Entschlüsselung beim Abruf.

- Client-seitige Verschlüsselung: Verschlüsselung erfolgt bereits vor dem Upload; der Kunde verwaltet Schlüssel und Tools selbst.

Transportabsicherung erfolgt über TLS/SSL oder durch VPN-basierte Netzwerke.

AWS PrivateLink für Amazon S3

Über PrivateLink lassen sich VPC-Endpunkte bereitstellen, um S3 aus dem eigenen Virtual Private Cloud (VPC)-Netzwerk zu erreichen, direkt über VPN, AWS Direct Connect oder VPC-Peering. So lassen sich sensible Workloads vom öffentlichen Internet isolieren.

Identitäts- und Zugriffsmanagement (IAM)

Standardmäßig sind alle Ressourcen (Buckets, Objekte, Subressourcen) privat. Zugriff erfolgt:

- über benutzerbasierte IAM-Richtlinien

- über ressourcenbasierte Richtlinien auf Bucket- oder Objektebene

Granulare Berechtigungsmodelle sichern sensible Unternehmensdaten ab und lassen sich rollenbasiert steuern, z. B. für DevOps, Data Analysts oder externe Partner.

Amazon S3 Performance-Richtlinien

Bei der Entwicklung von Anwendungen, die Daten in Amazon S3 hochladen oder abrufen, ist eine gezielte Optimierung der Performance entscheidend, insbesondere bei großen Datenmengen und verteilten Zugriffen. Die folgenden Empfehlungen helfen, die Leistungsfähigkeit von Amazon S3 optimal auszuschöpfen.

Performance messen und Engpässe identifizieren

Wenn Sie von Amazon EC2-Instanzen aus auf Amazon S3 zugreifen, sollten Sie die folgenden Ressourcen im Blick behalten:

- CPU-Auslastung

- Netzwerkdurchsatz

- Arbeitsspeicherbedarf (DRAM)

Abhängig von den Anforderungen kann es sinnvoll sein, andere EC2-Instanztypen mit höherer Bandbreite oder mehr Rechenleistung zu evaluieren.

Darüber hinaus sind folgende Metriken relevant für die Performance-Analyse:

- DNS-Latenz und Namensauflösungszeiten

- HTTP-Antwortzeiten und Übertragungsgeschwindigkeit

Zur Analyse können gängige HTTP-Analyse-Tools oder Netzwerk-Monitoring-Werkzeuge eingesetzt werden.

Horizontale Skalierung von Speicherzugriffen

Amazon S3 ist ein hochgradig verteiltes Speichersystem und sollte auch so behandelt werden. Eine effektive Methode zur Performance-Steigerung ist die horizontale Skalierung über parallele Verbindungen:

- Vermeiden Sie Einzelanfragen über nur eine Netzwerkverbindung.

- Senden Sie gleichzeitige Anfragen über mehrere Verbindungen, um die verfügbare Bandbreite effizient zu nutzen.

- Amazon S3 begrenzt nicht die Anzahl gleichzeitiger Verbindungen zu einem Bucket.

Diese Strategie eignet sich besonders für leistungsintensive Anwendungen mit hohem Datenvolumen oder hoher Transaktionsfrequenz.

Amazon S3 Transfer Acceleration nutzen

Mit Amazon S3 Transfer Acceleration lassen sich große Datenmengen schneller und sicherer über große Distanzen übertragen. Die Funktion nutzt das globale Amazon CloudFront Edge-Netzwerk, um Daten über optimierte Routen an den Ziel-Bucket zu liefern.

Transfer Acceleration eignet sich besonders für:

- Uploads aus verschiedenen Regionen in einen zentralen S3-Bucket

- Datentransfers von mehreren Gigabyte bis hin zu Terabyte

- internationale oder globale Nutzungsszenarien

Tipp: Mit dem S3 Transfer Acceleration Speed Comparison Tool können Sie die Upload-Geschwindigkeit mit und ohne Beschleunigung vergleichen, direkt aus dem Browser für unterschiedliche AWS-Regionen.

Retry-Strategien für latenzsensitive Anwendungen

Da Amazon S3 auf eine hochverteilte Infrastruktur setzt, kann eine erste Anfrage gelegentlich verzögert sein. Eine erneute Anfrage (Retry) nimmt häufig einen alternativen Pfad mit besserer Performance.

- Aggressives Retry-Verhalten kann für stabilere Latenzen sorgen.

- Die AWS SDKs bieten konfigurierbare Optionen für Timeouts und Retry-Mechanismen.

- Stimmen Sie diese Einstellungen auf die Toleranzgrenze Ihrer Anwendung ab.

AWS-Speicheroptimierung mit Cloud Volumes ONTAP

NetApp Cloud Volumes ONTAP ist eine führende Lösung für das Enterprise-Storage-Management in der Cloud. Sie bietet sichere und bewährte Funktionen auf AWS, Azure und Google Cloud. Cloud Volumes ONTAP skaliert in den Petabyte-Bereich und unterstützt vielfältige Anwendungsfälle, von Dateidiensten über Datenbanken bis hin zu DevOps-Workloads und containerisierten Anwendungen.

Zu den wichtigsten Funktionen zählen:

- Hochverfügbarkeit und Datenschutz

- Speicheroptimierung durch Thin Provisioning, Komprimierung und Deduplizierung (Einsparungen von bis zu 70 %)

- Integration in Kubernetes-Umgebungen

- Unterstützung für unternehmenskritische Workloads

Lesetipp: Erfolgreiche Einsparpotenziale durch Cloud Volumes ONTAP Storage Efficiency Case Studies.